¿Qué pasaría si juntaras todo el talento de una institución que lleva más de 150 años investigando en todo tipo de disciplinas –elegida como la universidad número uno del mundo por octavo año consecutivo y habitada por cerca de 20.000 cabezas pensantes entre profesores, investigadores y alumnos– para tratar de descubrir los fundamentos de la inteligencia? Es, grosso modo, lo que pretende el MIT Quest For Intelligence, una iniciativa del Instituto Tecnológico de Massachusetts (MIT) puesta en marcha por su propio presidente, Rafael Reif. El español Antonio Torralba, director de la Facultad de Inteligencia Artificial y Toma de Decisiones (IA+D) del MIT, capitanea el proyecto como director inaugural desde su creación. MUY INTERESANTE le ha entrevistado en su despacho en el Laboratorio de Ciencias de la Computación e Inteligencia Artificial –el conocido CSAIL–, en Boston, donde combina clases, investigación y tareas como investigador principal. También codirige el laboratorio MIT-IBM Watson AI Lab, y es parte del centro Cerebros, Mentes y Máquinas del MIT. Torralba ha recibido numerosos premios por su trabajo como investigador, tanto por su carácter innovadorvomoy por su excelencia docente.

“El Quest for Intelligence es una iniciativa de alto nivel que nació desde la presidencia del MIT con el objetivo de entender qué es la inteligencia y cómo funciona el cerebro humano no solo desde la perspectiva de la neurociencia, sino a nivel cognitivo”, explica Torralba. Quest, como lo llama abreviadamente el investigador, representa la visión del MIT sobre la importancia de la inteligencia artificial para desarrollar la próxima generación de herramientas de aprendizaje automático. “Es un proyecto a muy largo plazo que nace con la ventaja de tener, en un espacio condensado, mucha investigación en neurociencia, ciencia cognitiva y machine learning, con numerosos investigadores que observan al cerebro a todos niveles y estudiosos de ciencias sociales y humanidades que tratan de entender el impacto de la IA en la sociedad”, resume.

Quest engloba a todo el campus del MIT y a la cúpula de directores. “Es un caldo de cultivo único”, afirma Torralba. Su trabajo como director es buscar financiación para cada área de investigación, a las que denominan moonshots; algo así como ‘lanzamientos de cohetes a la Luna’. También se ocupa de organizar eventos y talleres para generar comunidades interdisciplinares y que la propia gente del MIT se conozca. Se trata, en definitiva, de fomentar interacciones y conexiones que desemboquen en perspectivas diferentes con el fin de atajar problemáticas similares.

Actualmente, hay veinte departamentos del campus con proyectos dentro del Quest relacionados con las claves de la inteligencia natural y artificial, sin perder de vista su aplicación a variopintos campos de conocimiento. Por ejemplo, se puede usar en química para predecir nuevas moléculas con propiedades muy concretas. “Así, en lugar de explorar todas las combinaciones posibles e ir probando hasta encontrar cuál tiene la característica que buscas, puedes construir un sistema que predice qué molécula o mezcla es más probable que adquiera dicha propiedad”, ilustra Torralba.

El Quest también pretende comprender los problemas reales de la industria y proporcionar soluciones que tengan un impacto en la sociedad. De entre los moonshots actualmente en marcha, Torralba destaca varios. Uno que le apasiona es el que dirige el experto en ciencias cognitivas y del cerebro Josh Tenenbaum, que trata de entender el desarrollo de un niño desde que nace hasta que tiene un año y medio. “Ese periodo del desarrollo es muy interesante desde el punto de vista de la IA porque se ponen de manifiesto algunos de los mecanismos que luego serán importantes en la edad adulta. Como sistema que interactúa con el mundo, un bebé de un año es ya experto en muchas cosas, aunque no sepa nada de la vida”, afirma Torralba.

Lo que se trata de entender es cómo una persona de corta edad es capaz de aprender todo lo necesario para llegar hasta ahí, “que es lo verdaderamente sorprendente”. Por ejemplo, la adquisición de una noción tridimensional perfecta del mundo en el que se encuentra, o la precisión mecánica y el nivel de agilidad suficientes para manejar objetos. “Un robot tendría muchas dificultades para hacerlo”, señala el investigador.

Este proyecto examina las sutilezas en el desarrollo mental que explican por qué en un determinado momento los pequeños se sorprenden por una cosa –como cuando alguien se oculta detrás de sus manos y aparece de nuevo– y en otro no. O cuándo exactamente los bebés japoneses -capaces de entender la diferencia entre los fonemas correspondientes a nuestras letras erre y ele– se dan cuenta de que existen unas estructuras atómicas, indivisibles, para asimilar el lenguaje, crean el concepto de categoría fonética, descubren que en su entorno erre y ele son un mismo sonido y pierden la capacidad de distinguirlos.

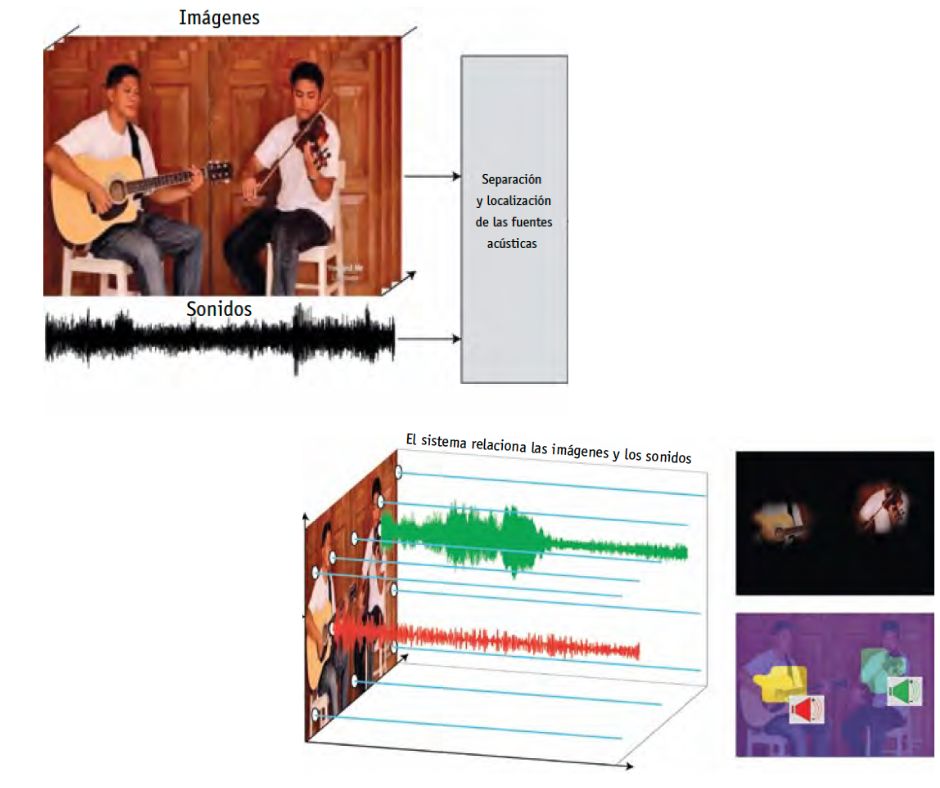

Por otra parte, el ser humano cuenta desde que nace con diferentes modalidades sensitivas, percibe el exterior fundamentalmente a través de imágenes, sonidos y estímulos táctiles. Por eso, los científicos del Quest trabajan en la construcción de un sistema que pueda integrar las tres vías citadas. Su primera aproximación es desarrollar una tecnología capaz de identificar en una imagen qué objetos están haciendo sonidos, de captar qué píxeles están produciendo el estímulo sonoro y qué componente del ruido viene de ese píxel.

Lo que trata de imitar este sistema es el fenómeno cerebral conocido como el efecto de fiesta de cóctel: en una celebración hay mucho ruido de fondo, que puede ser más potente que la voz de la persona con la que estamos hablando, pero aun así podemos entenderla y mantener una conversación. “Con la música pasa lo mismo. Queremos un sistema capaz de ver vídeos de música y descubrir automáticamente que existen diferentes instrumentos, saber que estos pertenecen a clases concretas y aislar el sonido que viene de cada cual, de forma que escuche cada instrumento por separado en una grabación multicanal”, explica Torralba.

Por el momento, han demostrado que el uso de la visión y la audición de manera simultánea permite resolver este problema mucho mejor que si solo se utiliza uno de los dos. Sus hallazgos se plasman en el proyecto The Sound of Pixels –el Sonido de los Píxeles–, donde además de la explicación de los estudios se puede encontrar una demostración.

En cuanto al tacto, Torralba señala que es el sentido clave para los seres humanos –y no la vista, como comúnmente se cree–, ya que determina la posición en el espacio físico. “Hay muy pocas personas que carecen de tacto porque, sin él, tendrían muy pocas posibilidades de supervivencia. La evolución ha hecho que este error no se pueda cometer, lo cual refleja su importancia”, señala.

Por eso, resulta esencial también conferir tacto a los robots. Por el momento, lo que se hace es integrar en ellos sensores, pero estos todavía son demasiado sencillos y poco sensibles. “Estamos empezando a crear sensores a la altura de los visuales; al menos, lo suficiente como para reconocer y recrear una imagen táctil de suficiente calidad del objeto y poder actuar al respecto”, dice.

También trabajan en cómo integrar la vista y el tacto: entrenar al sistema para predecir cómo va a sentirse antes de tocar algo. Por ejemplo, para evitar que meta los dedos en el fuego porque sabe que quema, o para identificar por dónde debe agarrar un objeto.

Otro de los moonshots del Quest intenta resolver el problema de insertar la inteligencia artificial en una estructura física. “La IA necesita un cuerpo, pero hoy en día la robótica no está lo suficientemente avanzada para integrarlo. La mayor parte de sistemas de IA viven en un ordenador y toda la interacción se realiza dentro de una pantalla, no juegan con el mundo real. Y los robots que existen hoy en día son demasiado sencillos”, señala Torralba.

Por eso quieren estudiar modelos de IA que residan en una estructura mecánica para desarrollar este sistema conjuntamente: que sea capaz de interactuar con el mundo y que aprenda a través de dichas interacciones para adaptarse al entorno. “Queremos profundizar en el problema de estudiar el mundo de la percepción y del aprendizaje desde la experiencia de un robot”, señala el investigador.

El binomio IA/ética protagoniza otro proyecto del Quest destacado por Torralba. Trata de entender cuál es el impacto de ciertas herramientas de inteligencia artificial en la sociedad y cuáles son los parámetros con los que debemos guiarnos a la hora de construir sistemas inteligentes. “Inteligentes entre comillas, porque más bien hablamos de herramientas capaces de tomar decisiones complejas, que empiezan a comportarse de formas susceptibles de perpetuar sesgos y prejuicios o cometer errores injustos con diferentes tipos de población”, indica.

Para Torralba, lo interesante es saber si un sistema es injusto o no. Y averiguarlo resulta más fácil que con las personas, ya que estas pueden negarlo o justificarse. “El sistema simplemente es una función que obtiene una entrada –input– y produce una salida –output–, y podemos cambiar el tipo de entrada para saber si tiene un sesgo o no”, explica. Esto permite establecer los fundamentos teóricos en los que expresar dichos problemas y plantear la posibilidad de medir si un sistema actúa de manera discriminatoria.

El segundo paso a seguir es que, si es posible definir las desviaciones, ¿cómo se podrían integrar dichas definiciones en un sistema para que no discrimine? ¿Cómo incorporar normas de moral o nuevos términos en modelos de aprendizaje automático para asegurar que cuando estos aprenden no lo hacen con los sesgos que existen en la base de entrenamiento? Pensemos, por ejemplo, en un sistema automático que se encarga de dar recomendaciones para contratar a trabajadores en función de los currículos presentados y cuya base de entrenamiento reconoce en los datos que los hombres blancos han sido más proclives a ser elegidos. La máquina incorporará esos atributos como elementos positivos a tener en cuenta.

“Una persona que tienda a beneficiar a perfiles masculinos o a personas de determinada edad no lo reconocerá. Sin embargo, con la máquina puedes comprobarlo cambiando la etiqueta del currículo para indicar que es hombre o mujer o su edad, y viendo qué decisión toma en función de ello”, señala Torralba. No es siempre tan sencillo, pues puede haber otros elementos en el currículo que permitan predecir el género y la edad de alguien, así como en qué año se graduó. “Es necesario tener esto en cuenta para manipular también dichos parámetros y observar si tiene un efecto en el resultado”, apunta el investigador español.

Otro de los retos vinculados a este asunto radica en establecer quién decide qué atributos son buenos o malos para elaborar un juicio, ya que a veces ciertas características pueden parecer importantes en el proceso de predicción. ¿Cuándo usarlas o cuándo no? Y después, ¿cómo evaluar el sesgo? Hay muchas formas y todas abocan a resultados distintos. Esta compleja área sigue en proceso de investigación.

El gran reto es definir los valores sobre los que se asientan los sistemas de IA, que pueden ser muchos.“La sociedad y los políticos van a tener que decidir los axiomas en los que nos vamos a basar y, a partir de ahí, tomar medidas. Mientras tanto, nosotros podemos identificar parte de estos problemas; el beneficio de colaborar con la industria es que nos abre los ojos a ellos”, comenta Torralba. No hay establecida una forma concreta y correcta sobre cómo proceder éticamente en la IA –subraya–, sino que es algo por investigar. “Tener estas herramientas permite formalizar el problema y convertirlo en un área de estudio. No vamos a obtener respuestas definitivas, sino que va a haber una evolución de las mismas. Debemos ir aprendiendo, y lo que exista hoy parecerá primitivo en cincuenta años”, predice Torralba.

La máxima ambición del investigador, “aunque suene un poco cliché”, es construir sistemas que puedan percibir el mundo como lo hacen los humanos. Como primer paso, le gustaría tener un robot capaz de vivir en casa y ayudar con las tareas domésticas. “Esto no es fácil; si lo fuera, ya estarían aquí. Todos los problemas que hay que resolver para ello están aún muy verdes”, afirma.

Y hablando de clichés: ¿cree Torralba que desarrollaremos máquinas superinteligentes capaces de volverse en nuestra contra o destruir a los humanos? “La IA no va a querer que desaparezcamos porque carece de deseos. Solo sigue objetivos que pueden ser buenos o malos, pero los definimos nosotros”. ¿Tendrá conciencia algún día? “No en los próximos cien años. Es poco probable que pase antes, porque no tenemos ni idea de cómo funciona. Es muy posible que la conciencia desempeñe un papel muy importante en la inteligencia, y si es así, vamos a tener que entenderla, se convertirá en un objetivo. Pero hoy en día no sabemos siquiera cómo plantearlo como pregunta”, sostiene.

Torralba da más motivos para avanzar en la vía de la superinteligencia: “Forma parte de la naturaleza del ser humano entender el mundo que le rodea para adaptarse y ser capaz de llegar donde otras especies no lo hacen. En ese proceso se incluye comprendernos a nosotros mismos y nuestro sitio en el mundo. Las respuestas las vamos encontrando a partir de investigaciones de este tipo. También hay cuestiones que no tienen contestación o que el ser humano nunca estará capacitado para contestar. Aunque mi hipótesis es que este no será el caso, ya que el cerebro parece poseer la estructura necesaria para averiguar cómo funciona o incluso para mejorarse a sí mismo y acabar entendiéndolo”.

“El estudio de la IA es muy interesante para la gente en general, no solo para los científicos o para las empresas que la van a aplicar”, añade. ¿Por qué? Porque construir máquinas que pueden razonar nos hace reflexionar sobre nuestros propios mecanismos de razonamiento y esto puede ayudarnos a mejorar cómo pensamos –de qué forma discriminamos o somos sensibles a sesgos, etcétera–, corregirlo y mejorarlo. “Cuando herramientas así surgen, nos hacen cambiar como sociedad. Si no evolucionamos para usarlas de manera correcta, nos extinguiremos. El fuego nos enseñó ciertas cosas y la IA nos enseñará otras”, concluye.

* Este artículo fue originalmente publicado en una edición impresa de Muy Interesante